AI“换脸”骗局猖獗 新技术如何不被沦为犯罪工具

OPENAI发布文本转视频模型SORA引发全球关注。这类技术的普及除了将颠覆视频内容的生产方式,也让造假成本更低廉。一些不法分子利用AI技术融合他人面孔和声音,制造非常逼真的合成图像来实施新型网络诈骗,这类骗局常常会在短时间内给被害人造成较大损失。

近日,陕西西安从事财务工作的张女士在与老板视频通话时,老板要求她转账186万元到一个指定账号。由于张女士看到视频中人就是老板本人,声音也是老板的声音,所以就按照要求直接把186万转到指定账号。转账之后,张女士按照规定将电子凭证发到了公司财务内部群里,然而出乎意料的是,群里的老板看到信息后,向她询问这笔资金的来由。张女士这时候才意识到自己被骗了,连忙报警求助,警方立刻对接反诈中心,联系相关银行进行紧急止付,最终保住了大部分被骗资金156万元。

香港警方近日也披露了一起AI“多人换脸”诈骗案,涉案金额高达2亿港元。在该起案件中,一家跨国公司香港分部的职员,受邀参加总部首席财务官发起的多人的视频会议。并按照要求,前后转账多次,将2亿港元转账到5个本地银行账户内,其后向总部查询方知受骗。警方调查得知,这起案件中,所谓的视频会议中,只受害者一人为“真人”,其余所谓参会人员,全部是经过AI换脸后的诈骗人员。

那么,AI换脸背后的技术原理到底是什么?在技术层面,它是如何实现人脸的精确识别与替换,创造出逼真效果?为了了解AI换脸到底能有多么逼真,记者经过与专业技术人员合作,深度体验了AI换脸技术。技术人员首先是用手机给记者拍了一张脸部照片,导入到AI人工智能软件后,虽然电脑摄像头前的是技术人员,但是输出的却是记者的照片,几乎可以说是一键换脸,不需要复杂的环境和解压操作。更令人惊讶的是随着技术人员面部表情变化,照片上记者的脸也跟着一起发生了相应变化。

据介绍,AI换脸过程包括为三个部分,首先,利用深度学习算法精准地识别视频中的人脸图像,并提取出如眼睛、鼻子、嘴巴等关键面部特征。其次,将这些特征与目标人脸图像进行匹配、替换、融合。最后,通过背景环境渲染并添加合成后的声音,生成逼真度较高的虚假换脸视频。

如今,随着Sora的问世,已经可以用更少的人脸数据构造高逼真的特定人脸模型。对此,业内专家表示,技术发展让AI换脸技术的门槛变得越来越低。而这类技术的普及,也会导致深度伪造内容更加泛滥,进而增加被用于诈骗、色情等违法犯罪活动的风险和隐患。举个简单的例子,骗子利用新技术生成一个你的熟人出现“意外事故”的视频和正在医院被推入抢救室的视频,同时再利用特殊方式恶意造成当事人电话占线,社交账号被盗,这时在打电话索要“手术费”。或许这一系列操作下来,被诈骗的人可能很容易就上当受骗。

此前,我们认为的每个人的声音和相貌都具有独特性,不过深度伪造技术正在打破这一边界,致使“眼见、耳闻”都不再为实。除了一些不法分子企图利用AI换脸技术实施诈骗,AI技术还被应用于短视频的二次创作。不过,即使是出于娱乐使用AI换脸、AI换声,也是存在法律风险的。例如,擅自将他人的照片或视频用Ai进行更改,可能涉嫌侵犯肖像权。而使用他人的声音制作音频则涉嫌侵犯声音权。这些在《中华人民共和国民法典》都有规定,对自然人肖像、声音的使用必须针对本人同意,否则就涉嫌违法。

那么,面对技术发展带来的安全风险我们又该如何防范?事实上,针对这些问题,有关部门发布了多项监管措施。2023年8月15日,我国正式施行《生成式人工智能服务管理暂行办法》。《办法》从多个方面划下红线,旨在促进生成式人工智能健康发展和规范应用。

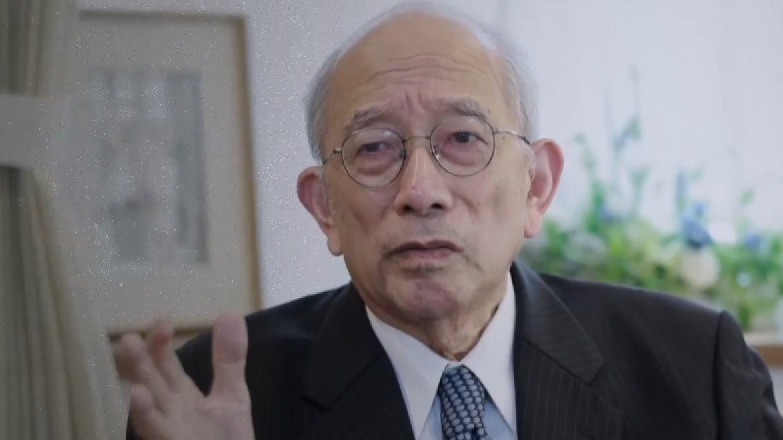

面对不断迭代的新技术,以及带来安全风险,除了要提高自我防范意识,该如何规制技术不被滥用,相关部门又该如何形成有效的监管?复旦大学信息科学与工程学院副教授凌力表示,AI技术发展很快,最新的Sora已经能够做到根据文本来生成一段逼真的视频,画面细节和质量已经可以达到电影级。AI技术迅速发展也带来一些问题,那就是我们还能说眼见为实吗?像Sora这样功能强大的AI工具目前并不少见,前几年已经出现的DeepAI这样一种深度伪造的技术,以让一张照片动起来,或者说把一个人的人脸替换到另外一个人的视频上,这种方法给不法分子以新的手段来编造负面的视频进行敲诈,甚至进行视频通话,因为声音也可以用AI技术来伪造,从而引发新的安全问题。可以说深度伪造等技术发展应用,对于个人信息安全造成越来越大的冲击。

在凌力看来,新技术往往是一把双刃剑,在带来便利的同时,如果被恶意利用就会变成更有杀伤力的犯罪手段。利用像Sora这类软件制作视频来进行诈骗,是很难被人眼识别的,也就是说防不胜防。凌力建议,可在技术手段上进行防范,首先需要进一步加强公民个人信息保护,尤其是加强对生物特征等隐私信息的技术、司法保护力度。让AI深度伪造技术的服务平台、公司推行隐形水印机制,通过在视频、音频和图像中嵌入不可见的水印保护信息,以快速识别AI合成内容并进行溯源,各个社交平台也应以技术手段加强对于疑似AI生成图、文、视频内容的识别功能。除了技术解决方法外,凌力认为随着科技的飞速发展,我们相关的法律法规也应逐步健全,要进一步完善人工智能等领域相关法律。只有通过技术和法律等手段,规避人工智能技术带来的风险隐患,使之健康有序发展。

看看新闻Knews编辑:彭晓燕 翟静 陈昱卉

| 编辑: | 翟静 陈昱卉 |

| 责编: | 彭晓燕 |

推荐视频

剑网行动举报电话:12318(市文化执法总队)、021-64334547(市版权局)

Copyright © 2016 Kankanews.com Inc. All Rights Reserved. 看东方(上海)传媒有限公司 版权所有

沪公网安备 31010602001114号

沪公网安备 31010602001114号

全部评论

暂无评论,快来发表你的评论吧